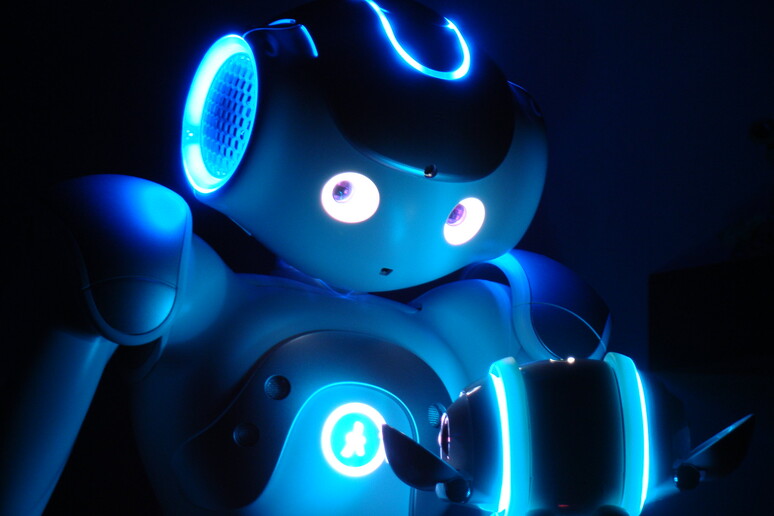

Robot capaci simulare emozioni, a partire dal rimorso e il rimpianto: è questa una delle prossime sfide, soprattutto in vista degli automi destinati a interagire con gli umani nei luoghi di lavoro o nelle case. Ad accendere il dibattito è l'articolo pubblicato sulla rivista Science Robotics dell'esperta di interazione uomo-macchina Robin Murphy, dell'Università A&M del Texas. A ispirare la riflessione è il recente romanzo di fantascienza Sea of Rust di Robert Cargill, punto di partenza della ricercatrice per sottolineare alcuni dei pericoli insiti nelle emozioni espresse dai robot, in particolare il rischio manipolazione degli umani.

"Quando parliamo di emozioni nel mondo dei robot o dell'Intelligenza Artificiale, siano di rimorso o rimpianto oppure di gioia o tristezza, deve essere ben chiaro che non si tratta di vere emozioni bensì di emozioni simulate. I robot non possono avere cognizione di cosa sia la gioia o la tristezza", ha detto all'ANSA il giurista esperto di robotica e interazione uomo-macchina Andrea Bertolini, della Scuola Superiore Sant'Anna di Pisa.

Le emozioni simulate nei cosiddetti agenti artificiali, le macchine, sono sempre più studiate e utilizzate per semplificare la loro accettazione da parte degli umani, fino ad arrivare a usi manipolatori.

Nel breve articolo pubblicato su Science Robotics si prende spunto dal racconto di Sea of Rust in cui si narra di una ribellione dei robot nei confronti dell'uomo che si conclude con il totale annientamento dell'umanità. I robot rimasti soli si trovano a vivere in un mondo di violenze tra macchine e a convivere con quelli che possono in qualche modo essere definiti sensi di colpa e rimpianto per alcune delle scelte fatte, anche se in spesso in termini non umani. Il robot protagonista, ad esempio, rimpiange di aver ucciso gli umani in modi forse troppo cruenti, crucciandosi di non avere adottato scelte di eliminazione più efficaci. Il testo è un punto di partenza per riflettere sull'uso delle emozioni nei robot, in particolare del rimorso, in cui si sottolinea quanto sarà importante nel futuro calibrare l'implementazione delle emozioni.

"Ma siamo ovviamente lontanissimi dalla realtà", ha detto Bertolini. "Avere macchine capaci di provare emozioni - ha aggiunto - presuppone aspetti come la coscienza di sé. Se fosse così, vorrebbe dire che avremmo inventato luna forma di vita artificiale, ossia degli esseri viventi ma in realtà si tratta solo di macchine di utilità".

Un pericolo molto più concreto, ha aggiunto Bertolini, sono invece gli attuali usi manipolatori che si fanno delle emozioni: "crescono gli agenti capaci di usare la nostra propensione verso l'empatia per poi manipolarci". Uno degli esempi è Replika, una app sempre più diffusa in nord America che permette di creare un proprio partner virtuale, capace anche di avere interazioni sentimentali o a sfondo sessuale. Esprimere rimorso, oppure saper chiedere scusa in caso di errore, potrà essere una delle emozioni su cui gli agenti virtuali potranno fare facilmente leva per istaurare una maggiore empatia con gli umani.

Riproduzione riservata © Copyright ANSA